vSphere 对NVMe的支持

非易失性高速内存(NVMe)是一种标准化协议,用于与NVM设备进行高性能多队列通信。ESXi支持使用NVMe协议连接到本地和联网存储设备。

vSphere 7 中引入了以下功能特性,以增强对 NVMe 的支持

- 可插拔存储体系架构 (PSA) 堆栈,使用多路径高性能插件 (HPP)

- 热添加和热删除本地NVM设备(如果服务器支持)

- 支持通过光纤通道或 RDMA 连接的联网NVMe 设备

支持的 NVMe 拓扑

NVMe 存储可以直接连接到主机,或通过不同的架构传输间接连接,这称为共享的基于架构的 NVMe,或简称为 NVMe-oF。

| NVMe 传输 | ESXi 7 及更高版本支持 |

|---|---|

| 基于 PCIe 的 NVMe | 本地存储 |

| 基于 RDMA 的 NVMe | 共享 NVMe-oF 存储 |

| 基于光纤通道的 NVMe (FC-NVMe) | 共享 NVMe-oF 存储 |

| 基于 TCP 的 NVMe | 共享 NVMe-oF 存储 |

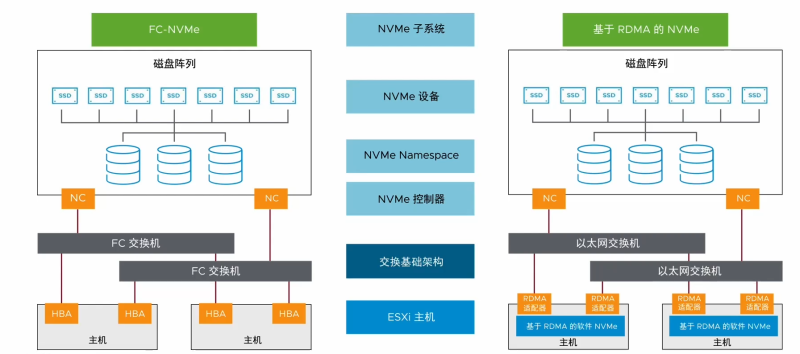

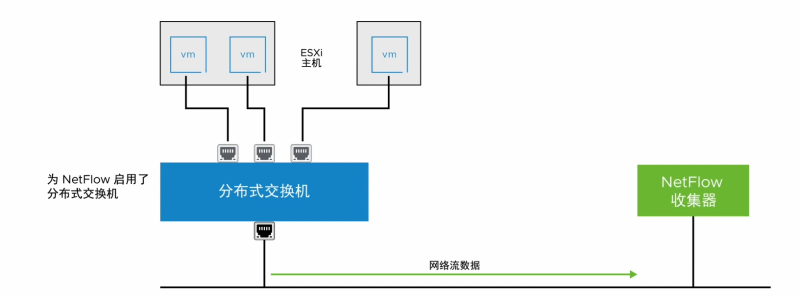

FC-NVMe 和基于RDMA 的NVMe(RoCEv2)

vSphere7及更高版本支持远程访问NVMe-oF,其中包括FC-NVMe 和基于 RDMA的NVMe拓扑。

![图片[1]-NVMe存储系统-宸玚的知识库](https://doc.chario.cn/wp-content/uploads/2026/03/image-37-1024x454.png)

FC-NVMe 支持

FC-NVMe是一种可将NVMe映射到光纤通道协议的技术。

借助FC-NVMe,可以在主机计算机和目标存储设备之间传输数据和命令。

要访问FC-NVMe 存储,必须在 ESXi主机上安装支持 NVMe的光纤通道存储适配器。

无需配置控制器。安装所需的硬件NVMe适配器后,它会自动连接到所有可访问的目标和控制器。

![图片[2]-NVMe存储系统-宸玚的知识库](https://doc.chario.cn/wp-content/uploads/2026/03/image-38.png)

FC-NVMe 要求

当您使用 FC-NVMe 时,需要具备以下组件:

- 支持 NVMe 的光纤通道存储阵列。

- 存储阵列上的 NVMe 控制器。

- ESXi 7 或更高版本。

- ESXi 主机上的硬件 NVMe 适配器:该适配器通常是支持 NVMe 的光纤通道主机总线适配器 (HBA)。

NVMe-oF 的最高配置:

- 256 个命名空间

- 2048 条路径

- 每台主机每个命名空间 4 条路径

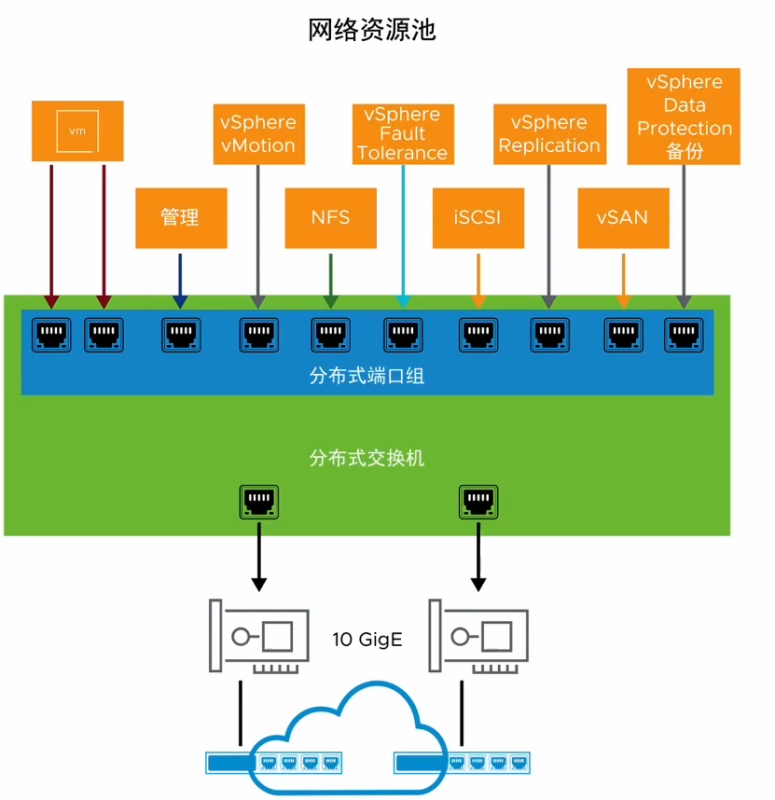

支持基于 RDMA 的 NVMe (RoCE v2)

基于 RDMA 的 NVMe(RoCE v2)技术使用 RDMA 在网络上的两个系统之间传输。

数据交换在主内存中进行,绕过这两个系统的操作系统和处理器。

ESXi7及更高版本支持RoCEv2 技术,通过以太网实现RDMA。

为了访问存储,ESXi主机将使用安装在主机上的RDMA网络适配器以及基于 RDMA 的 NVMe 存储软件适配器。

![图片[3]-NVMe存储系统-宸玚的知识库](https://doc.chario.cn/wp-content/uploads/2026/03/image-39.png)

基于 RDMA 的 NVMe (RoCE v2) 的要求

基于 RDMA 的 NVMe (RoCE v2) 需要以下组件:

- 支持基于 RDMA 的 NVMe (RoCE v2) 传输的 NVMe 存储阵列

- 存储阵列上的 NVMe 控制器

- ESXi 7 或更高版本

- 支持无损网络的以太网交换机

- ESXi 主机上支持 RoCE v2 的网络适配器

- ESXi 主机上启用了基于 RDMA 的 NVMe 软件适配器

NVMe-oF 的最高配置:

- 32 个命名空间

- 128 条路径

- 每台主机每个命名空间 4 条路径

为基于 RDMA 的 NVMe (RoCE v2) 配置 ESXi

要配置 ESXi 主机,以使用基于 RDMA 的 NVMe (RoCE v2),请执行以下操作:

- 在您的 ESXi 主机上安装支持 RDMA (RoCE v2) 的网络接口。

- 在 vSphere Client 中,确认主机已发现 RDMA 适配器。

- 为 RDMA 适配器配置 VMkernel 绑定。

- 验证 RDMA 适配器的 VMkernel 绑定配置。

- 启用基于 RDMA 的 NVMe 软件适配器。

- 发现阵列上的 NVMe 控制器(自动或手动)。

- 重新扫描存储,以发现 NVMe 命名空间。

- 创建您的数据存储。

确定与RDMA适配器对应的物理网络适配器。

没有物理网络适配器不会有这个选项

![图片[4]-NVMe存储系统-宸玚的知识库](https://doc.chario.cn/wp-content/uploads/2026/03/image-40-1024x588.png)

为基于 RDMA 的 NVMe 配置端口绑定,需要创建交换机并将物理网络适配器和 VMkernel 适配器连接到该交换机。

通过此连接,RDMA 适配器将绑定到 VMkernel 适配器

![图片[5]-NVMe存储系统-宸玚的知识库](https://doc.chario.cn/wp-content/uploads/2026/03/image-41-1024x582.png)

选择添加基于RDMA的NVMe 软件适配器,然后从下拉菜单中选择相应的 RDMA适配器(vmrdma)。

![图片[6]-NVMe存储系统-宸玚的知识库](https://doc.chario.cn/wp-content/uploads/2026/03/image-42-1024x576.png)

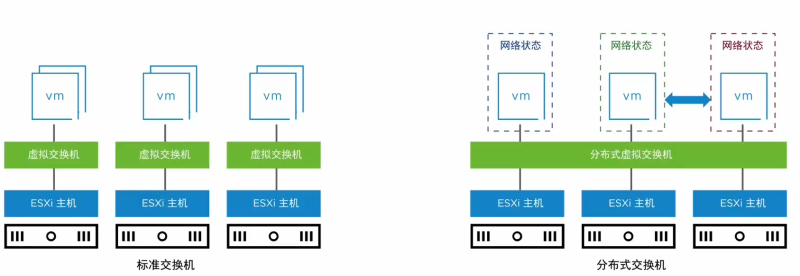

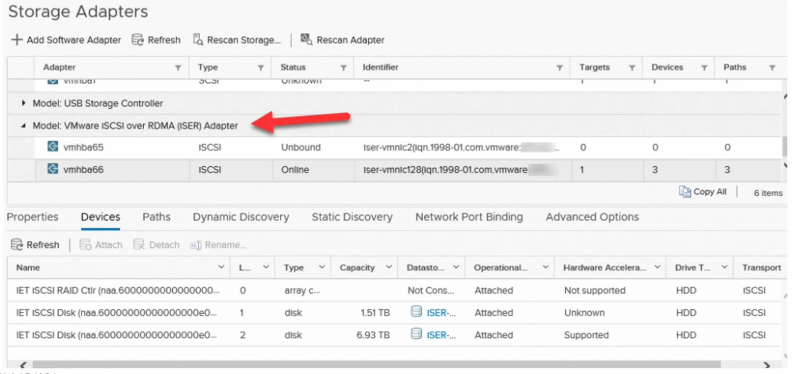

可插拔存储体系架构

可插拔存储体系架构是一种开放的模块化框架,用于协调负责多路径操作的各种软件模块。

| 首字母缩写词 | 定义 |

|---|---|

| PSA | 可插拔存储体系架构 |

| NMP | 原生多路径插件:与 SCSI 存储设备配合使用的通用 VMware 多路径模块 |

| PSP | 路径选择插件:处理 SCSI 存储设备的路径选择 |

| SATP | 存储阵列类型插件:处理给定 SCSI 存储阵列的路径故障转移 |

| MPP(第三方) | 多路径插件:由第三方开发和提供的多路径模块 |

| HPP | 由 VMware 提供的高性能插件:与超高速本地和联网闪存设备配合使用 |

| PSS | 路径选择方案:处理 NVMe 存储设备的多路径 |

![图片[7]-NVMe存储系统-宸玚的知识库](https://doc.chario.cn/wp-content/uploads/2026/03/image-43.png)

优先级:

第三方 MPP>VMware HPP>VMware NMP

- SATP:原生 / 第三方 → 二选一

- PSP:原生 / 第三方 → 二选一

- 整体多路径框架:NMP / HPP / MPP → 三选一

全部都是互斥,不可能混搭、叠加、同时生效。

不推荐原生+三方的混搭

高性能NVMe插件

HPP具有以下功能:

- 用作声明NVMe-oF目标的默认插件

- 只支持双活和隐性非对称逻辑单元访问(ALUA)目标

- 提高ESXi上安装的超高速闪存设备的性能

- 可以替换本地NVMe设备的原生多路径插件

- 支持NVMe-oF 的多路径

支持高性能插件多路径

HPP 可以提高 ESXi 主机上 NVMe 设备的性能。

| HPP 支持 | vSphere 7 及更高版本 |

|---|---|

| 存储设备 | 本地 NVMe PCIe、共享 NVMe-oF(仅适用于双活和隐性 ALUA 目标) |

| 多路径 | 是 |

| 第二级插件 | 否;路径选择方案 (PSS) |

| SCSI-3 永久预留 | 否 |

| 使用软件模拟的 4Kn 设备 | 否 |

| vSAN | 否 |

高性能插件最佳实践

要达到高速存储设备的最大吞吐量,请遵循以下建议:

- 针对 NVMe 本地或联网设备使用 HPP。

- 请勿针对硬盘或速度较慢的闪存设备激活 HPP。

- 使用 FC-NVMe 时,请遵循光纤通道存储的一般性建议。

- 使用 NVMe-oF 时,请勿在访问同一个命名空间时混用不同传输类型。

- 在注册 NVMe-oF 命名空间之前,请确保向主机提供有效路径。

- 将虚拟机配置为使用 VMware 半虚拟化控制器 (PVSCSI)。

- 将虚拟机配置为使用高延迟敏感度。

- 如果单个虚拟机支持设备 I/O 工作负载相当大的份额,则应考虑将 I/O 分散到多个虚拟磁盘。将硬盘挂接到虚拟机中的各个虚拟控制器。

暂无评论内容